生成AIの4つの欺瞞の種類

# 生成AIと4種類の欺瞞──サイバーセキュリティ応用を含む包括的技術探究

*2025年8月29日 Judith Simon 著*

2022年秋以降、生成AIは世界を席巻しました。数百万人の定常的ユーザー、数十億件のリクエスト、そして拡大する社会的インパクト──生成AIツールは創造的表現を再定義するだけでなく、複雑な倫理的・認識論的問題をも提起しています。本稿では、生成AIという現象を取り上げ、「四重の欺瞞」と呼ぶべき問題系を分解し、それらがサイバーセキュリティ領域とどのように交差するかを論じます。初心者向け概念から高度な技術応用、実例、さらには Bash と Python のコードサンプルまで、幅広いレベルの読者が新たな脅威を理解し軽減できるよう情報を提供します。

---

## 目次

1. [イントロダクション](#イントロダクション)

2. [生成AIの基礎](#生成aiの基礎)

- [生成AIとは何か](#生成aiとは何か)

- [基盤メカニズム](#基盤メカニズム)

3. [四重の欺瞞 ― 4つの類型](#四重の欺瞞-4つの類型)

- [1. 存在論的ステータスに関する欺瞞](#1-存在論的ステータスに関する欺瞞)

- [2. AI能力に関する欺瞞](#2-ai能力に関する欺瞞)

- [3. 生成AIで作成されたコンテンツによる欺瞞](#3-生成aiで作成されたコンテンツによる欺瞞)

- [4. 統合と機能における欺瞞](#4-統合と機能における欺瞞)

4. [生成AIとサイバーセキュリティ](#生成aiとサイバーセキュリティ)

- [現代サイバーセキュリティにおけるAI活用](#現代サイバーセキュリティにおけるai活用)

- [諸刃の剣としての生成AI](#諸刃の剣としての生成ai)

5. [実践的セキュリティ応用:スキャンとパース](#実践的セキュリティ応用スキャンとパース)

- [初級編:Bashによるネットワークスキャン](#初級編bashによるネットワークスキャン)

- [上級編:Pythonでスキャン結果をパース](#上級編pythonでスキャン結果をパース)

6. [AI駆動型欺瞞・サイバー攻撃の実例](#ai駆動型欺瞞サイバー攻撃の実例)

7. [倫理的含意と緩和策](#倫理的含意と緩和策)

8. [結論と今後の展望](#結論と今後の展望)

9. [参考文献](#参考文献)

---

## イントロダクション <a id="イントロダクション"></a>

生成AIとは、大規模データセットから学習したパターンを用いて、新たなテキスト・画像・音声・動画を生成する高度アルゴリズム群を指します。リアルなディープフェイクから人間のような文章生成まで、その成果は驚異的ですが、同時に深刻なリスクも孕んでいます。特に、生成AIは多層的な欺瞞を引き起こし、個人レベルだけでなく社会システム全体の信頼を損なう恐れがあります。

本稿では、生成AIの普及に伴い顕在化する4種の欺瞞を抽出し、その倫理的・認識論的影響のみならずサイバーセキュリティへの波及も分析します。哲学的洞察と技術的詳細を交差させ、セキュリティ専門家が新種のAI脅威を理解し軽減するためのガイドを提供します。

---

## 生成AIの基礎 <a id="生成aiの基礎"></a>

### 生成AIとは何か <a id="生成aiとは何か"></a>

生成AIは、膨大なデータを学習し新しいコンテンツを創出するAIのサブセットです。伝統的な分類・予測型AIと異なり、主に以下の技術を用います。

- **ディープラーニング** と *Transformer アーキテクチャ*(GPT系など)

- **変分オートエンコーダ(VAE)**

- **敵対的生成ネットワーク(GAN)**

これらモデルはウェブなどから収集した巨大データに潜む統計パターンを抽出し、確率分布に基づいて新規コンテンツを合成します。

### 基盤メカニズム <a id="基盤メカニズム"></a>

生成AIは本質的に確率的推論を行います。膨大な文書や画像を解析し、「次に来るトークン/ピクセル」の尤度を計算、クエリ時にはその確率からサンプリングする――これが生成の仕組みです。したがって結果は「エピステミック・ラック(偶然の正確さ)」の域を出ず、客観的真実に裏付けられているとは限りません。この性質が、生成AIを魅力的でありながら潜在的に欺瞞的なツールにしています。

---

## 四重の欺瞞 ― 4つの類型 <a id="四重の欺瞞-4つの類型"></a>

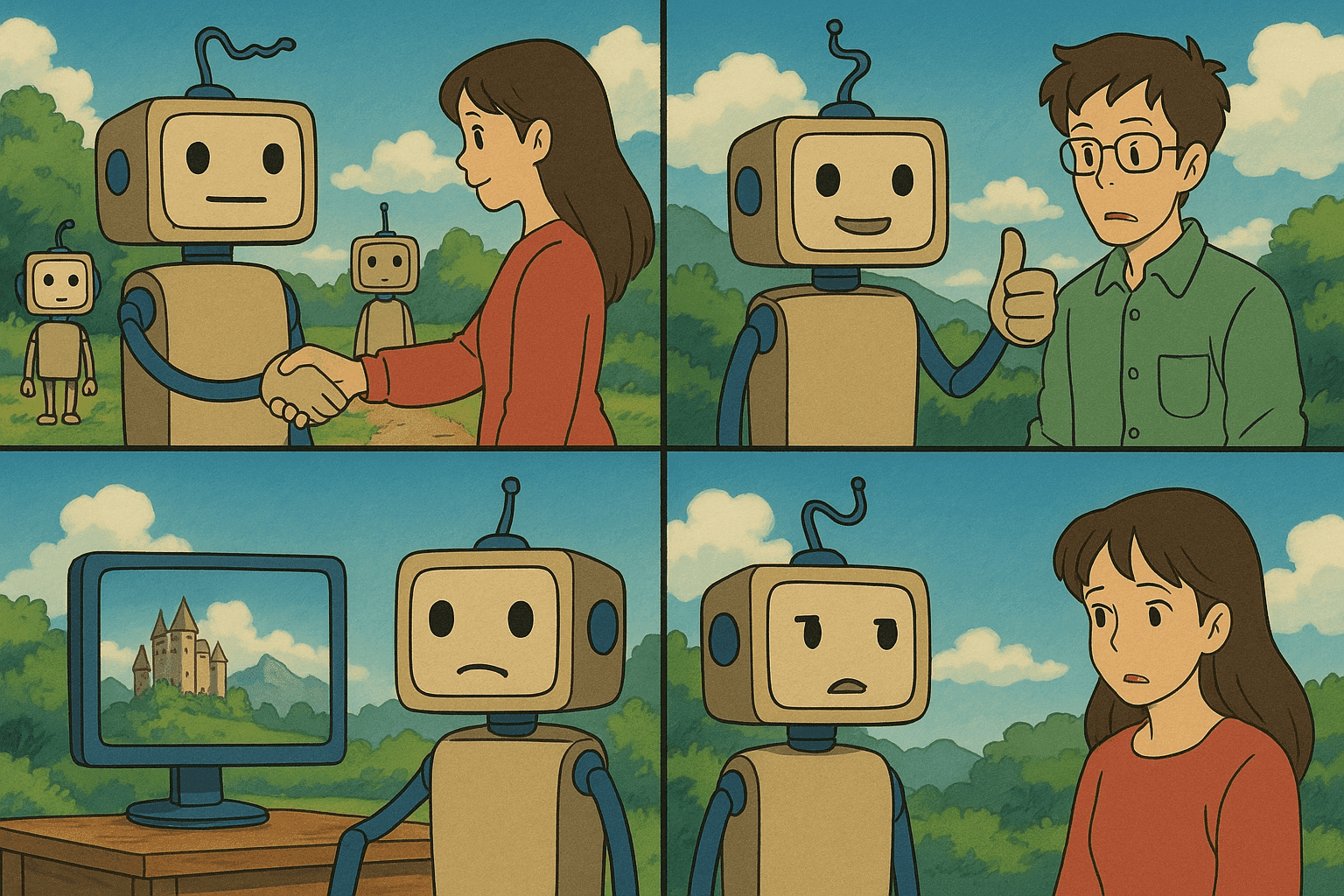

生成AIの普及は多層的な欺瞞の温床となります。本節では以下の「四重の欺瞞」フレームワークを提示します。

1. 存在論的ステータスに関する欺瞞

2. AI能力に関する欺瞞

3. 生成AIで作成されたコンテンツによる欺瞞

4. 統合と機能における欺瞞

### 1. 存在論的ステータスに関する欺瞞 <a id="1-存在論的ステータスに関する欺瞞"></a>

最も直接的なのは、相手が人間か機械かを誤認させる欺瞞です。顧客サポートでチャットボットを人間と勘違いする例が典型ですが、心理療法のように誤認の代償が大きい領域でも問題となります。

### 2. AI能力に関する欺瞞 <a id="2-ai能力に関する欺瞞"></a>

ChatGPT などの登場以降、「AIが共感や理解、さらには意識を持つ」といった主張が増えました。ELIZA 以来の擬人化傾向ですが、過度の信頼や誤った期待は心理的・制度的被害を招きます。

### 3. 生成AIで作成されたコンテンツによる欺瞞 <a id="3-生成aiで作成されたコンテンツによる欺瞞"></a>

ディープフェイク画像、偽の学術論文、巧妙なプロパガンダ──生成AIは説得力ある偽情報を高速・大量に作成できます。ソーシャルメディアと結びつくことで拡散速度は加速し、極めて深刻な脅威となります。

### 4. 統合と機能における欺瞞 <a id="4-統合と機能における欺瞞"></a>

生成AIが検索エンジンや顧客サポートに組み込まれる際、その性能が過大に宣伝されるケースがあります。「事実確認済みの検索結果」と誤認されれば、意思決定の基盤が崩れ、サイバーセキュリティ態勢にも影響します。

---

## 生成AIとサイバーセキュリティ <a id="生成aiとサイバーセキュリティ"></a>

### 現代サイバーセキュリティにおけるAI活用 <a id="現代サイバーセキュリティにおけるai活用"></a>

従来の署名ベース/異常検知に加え、AIは以下を支援します。

- **パターン認識**:異常トラフィックや不活性デバイスを検出

- **脅威シミュレーション**: plausible な攻撃経路を自動生成

- **自動脆弱性スキャン**:手動より高速に弱点を洗い出し

### 諸刃の剣としての生成AI <a id="諸刃の剣としての生成ai"></a>

攻撃側も生成AIでフィッシング文面、C2通信、ディープフェイク音声・動画を容易に生成可能です。例えば CEO を装ったメールで資金移動を指示するなど、従来の認証方法を無力化しかねません。

---

## 実践的セキュリティ応用:スキャンとパース <a id="実践的セキュリティ応用スキャンとパース"></a>

### 初級編:Bashによるネットワークスキャン <a id="初級編bashによるネットワークスキャン"></a>

```bash

#!/bin/bash

# network_scan.sh - nmap を用いた簡易ネットワークスキャン

if [ -z "$1" ]; then

echo "使い方: $0 <IPアドレスまたはホスト名>"

exit 1

fi

TARGET=$1

OUTPUT_FILE="scan_results.txt"

echo "対象: $TARGET をスキャン中..."

nmap -v -A $TARGET -oN $OUTPUT_FILE

echo "スキャン完了。結果は $OUTPUT_FILE に保存されました。"

上級編:Pythonでスキャン結果をパース

#!/usr/bin/env python3

"""

parse_scan.py - nmap 結果を解析して開放ポートを一覧表示

"""

import re

def parse_scan_results(filename):

open_ports = []

try:

with open(filename, 'r') as file:

for line in file:

# 例: "80/tcp open http" のような行を抽出

match = re.search(r"(\d+)/tcp\s+open\s+(\S+)", line)

if match:

port, service = match.groups()

open_ports.append((port, service))

except FileNotFoundError:

print(f"エラー: {filename} が見つかりません。")

return open_ports

if __name__ == '__main__':

results_file = "scan_results.txt"

ports = parse_scan_results(results_file)

if ports:

print("開放ポート一覧:")

for port, service in ports:

print(f"- ポート {port} : {service}")

else:

print("開放ポートが見つからないか、有効なデータがありません。")

AI駆動型欺瞞・サイバー攻撃の実例

政治プロパガンダにおけるディープフェイク

著名政治家が過激発言をする偽動画が拡散し、選挙干渉が疑われた事例がありました。検証までの短時間で世論が攪乱されました。

AI強化型フィッシング

SNSや会社サイトから収集したデータをもとに、CEOの文体を模倣したメールが生成され、機密情報が流出した事件が報告されています。

自動脆弱性発見

防御側ではAIが数千のコード変種を生成し脆弱性を特定しますが、攻撃者も同様の手法を逆用する可能性があります。

AIチャットボットによるソーシャルエンジニアリング

メンタルヘルス支援を求めたユーザがAIを人間と誤認し、機密情報を漏らす危険性が指摘されています。

記倫理的含意と緩和策

倫理的ジレンマ

- 信頼性:擬人化により誤った信頼が発生

- 責任帰属:意図的でなくとも開発者・企業の責任が問われる

- 社会的影響:偽情報でメディア・制度への信頼が侵食

緩和策

- 透明性と説明可能性:ウォーターマークや免責表示

- 認証プロトコル強化:多要素認証でなりすましを抑止

- 規制と監視:国際協調と業界標準の策定

- ユーザ教育:統計モデルの限界を周知

- AI支援型セキュリティ:AIで異常検知・真正性検証を自動化

結論と今後の展望

生成AIは強力な創造ツールである一方、多層的な欺瞞を誘発し得ます。本稿では、存在論・能力・コンテンツ・統合の4側面から欺瞞を分析し、サイバーセキュリティとの接点を示しました。Bash と Python のサンプルを通じ、実践的防御手法も紹介しました。

今後は自己監査可能で改ざん耐性を持ち、検証可能な出力を提供するAIの研究が必要です。技術者・セキュリティ専門家・政策立案者・ユーザが協働し、透明で倫理的な実践と強固なセキュリティ対策を継続的にアップデートすることで、AIの力を安全かつ責任ある形で活用できるでしょう。

参考文献

この包括的ポストは、欺瞞に関する哲学的議論と現代サイバーセキュリティの課題を橋渡しするものです。生成AIが社会のあらゆる分野に影響を及ぼす中、情報共有と積極的な技術的対策こそが潜在的被害を抑える最善策です。ご意見や質問があればぜひお寄せください。ともに、より安全で信頼できるデジタル未来を築いていきましょう。

サイバーセキュリティのキャリアを次のレベルへ

このコンテンツが価値あるものだと感じたなら、私たちの包括的な47週間のエリートトレーニングプログラムで何が達成できるか想像してみてください。ユニット8200の技術でキャリアを transformed した1,200人以上の学生に参加しましょう。